El Rincón del Vago, ese refugio al que muchos recurríamos en nuestra adolescencia para replicar trabajos, fue el escenario de una época gloriosa de atajos, donde la falta de esfuerzo era justificada por la necesidad de evitar tareas aburridas. Era el claro ejemplo de cómo el copiar contenido nos ahorraba tiempo, pero a costa de, muchas veces, despojarnos del propio aprendizaje. Aunque en ese contexto la intención no era necesariamente mala, ya que no había mala fe, sino más bien pereza, esta práctica de “copiar y pegar” reflejaba una forma de replicar contenido sin detenernos a reflexionar sobre las consecuencias de nuestras acciones.

Hoy en día, las réplicas han evolucionado a un nivel mucho más complejo. Herramientas como los generadores de arte anime con IA permiten a cualquiera, con simples indicaciones, producir imágenes que imitan los estilos de estudios renombrados como Studio Ghibli. Si bien el resultado es impresionante, el uso masivo de estas tecnologías está generando una falta de reflexión sobre las implicaciones éticas y legales, especialmente cuando se replican obras sin ningún tipo de permiso.

Sin embargo, la inteligencia artificial no siempre se usa con fines inocentes. Cada vez más, las herramientas de GenAI permiten generar documentos de identidad falsos con un nivel de detalle tal que superan la capacidad de los sistemas tradicionales para detectarlos. Lo que antes era una práctica limitada a expertos, ahora está al alcance de cualquier persona con un mínimo de conocimientos sobre cómo usar estas tecnologías.

Mientras que muchos usuarios recurren a la IA de manera creativa, la posibilidad de crear documentos de identidad que parecen auténticos está abriendo la puerta a un nuevo tipo de fraude. Yo me pregunto, ¿realmente podemos detectar estos documentos con con la ayuda de algoritmos y herramientas de detección de fraude?

Vamos a verlo.

La creación de pasaportes falsos con ChatGPT

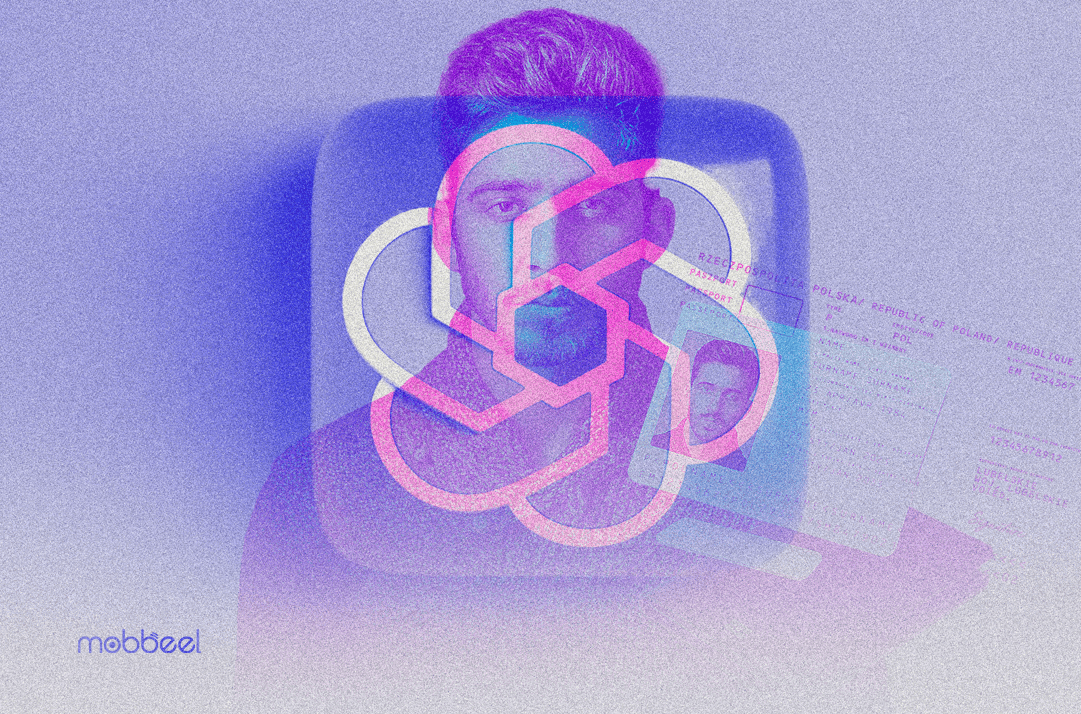

Hace apenas unas semanas, un Boris Musielak, investigador Polaco e inversor en stratups (entre ellas una empresa de KYC), volvió a poner el foco en el potencial uso malicioso de la IA generativa. En un experimento, confirmó haber utilizado ChatGPT-4o para generar un pasaporte falso en tan solo cinco minutos.

Según él, este documento sería capaz de superar los controles de verificación de identidad de algunas plataformas conocidas. La historia, cómo no, se viralizó. Muchos medios la recogieron como una señal de alarma: si la IA es capaz de crear documentos falsos tan reales, ¿qué margen de error les queda a las soluciones de verificación de identidad actuales?

La prueba no tardó en generar debate, tanto en periódicos digitales como redes sociales como en entornos profesionales vinculados a la identidad digital. Pero más allá del impacto mediático, conviene matizar algo sobre este fraude de identidad con IA generativa. El investigador no probó su pasaporte en todos los sistemas existentes ni demostró que estos documentos puedan superar validaciones biométricas con algoritmos bien entrenados. Lo que hizo fue visibilizar con un ejemplo extremo que las herramientas de generación automática pueden utilizarse, con el suficiente conocimiento, para crear documentos que engañen a ciertos procesos.

Y aunque su experimento no ratifica que estemos ante una amenaza generalizada, sí pone sobre la mesa un problema muy real: el de anticiparse a un tipo de fraude de identidad con IA genearativa cada vez más accesible. Uno que ya no requiere grandes redes de falsificadores, sino apenas una buena conexión, algunas instrucciones bien escritas y un modelo de lenguaje generativo al alcance de todos.

Qué es el fraude de identidad documental con IA generativa

El fraude de identidad documental con IA generativa consiste en la creación de documentos oficiales falsos mediante el uso de modelos de inteligencia artificial capaces de generar imágenes, textos y composiciones visuales que imitan los formatos reales.

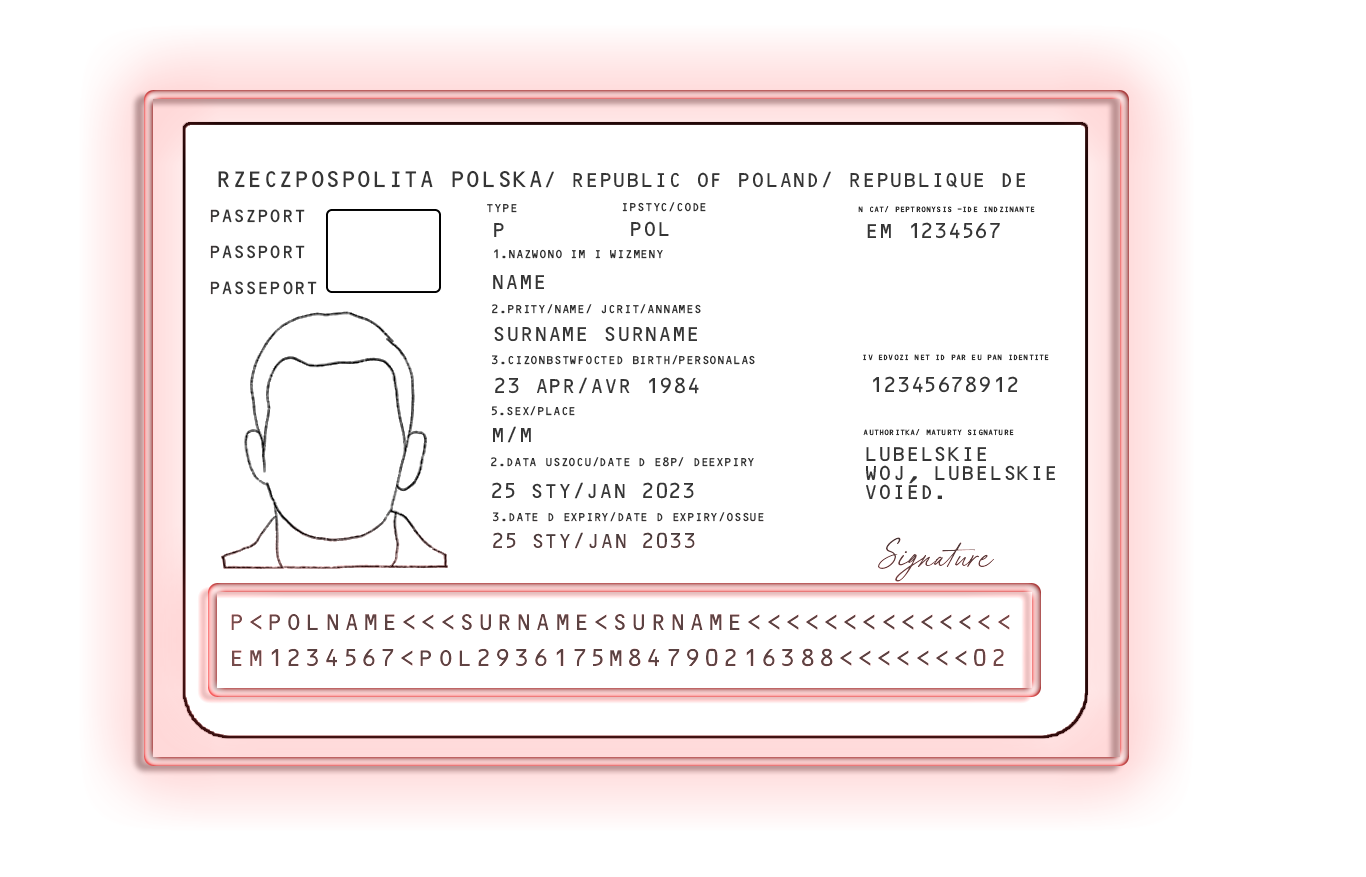

Falsificar una identidad ya no es lo que era. La inteligencia artificial generativa ha introducido una nueva forma de suplantación documental. A través de modelos que combinan texto e imagen, se pueden imitar algunos elementos. Sin embargo, la tecnología aún no ha alcanzado el punto de perfección que muchos temen. Generar un documento que «parezca» real puede ser relativamente sencillo, pero mantener la coherencia entre todos sus elementos, especialmente en lo que se refiere a MRZ o características de seguridad avanzadas sigue siendo una tarea compleja para estos modelos.

Lo preocupante no es tanto la calidad final del documento, que aún presenta inconsistencias, sino la velocidad con la que puede generarse uno aceptable. En apenas unos minutos es posible construir una versión falsificada que, si no se revisa con herramientas adecuadas, podría pasar desapercibida.

Ahora bien, esta amenaza no nos deja indefensos. Frente a un fraude sintético cada vez más automatizado, también evolucionan los mecanismos de defensa. Herramientas basadas en redes neuronales y algoritmos de aprendizaje automático permiten analizar no solo la apariencia de un documento, sino patrones y señales invisibles a nuestros ojos. La detección ya no se limita a comparar visualmente una imagen con una base de datos, sino a leer entre líneas lo que una generación artificial no puede ocultar del todo.

Y es precisamente ahí donde empieza a jugar su papel la tecnología como la que venimos desarrollando desde 2009 desde Mobbeel.

Cómo detectar un ID o pasaporte falso con los mecanismos de detección de fraude de Mobbeel

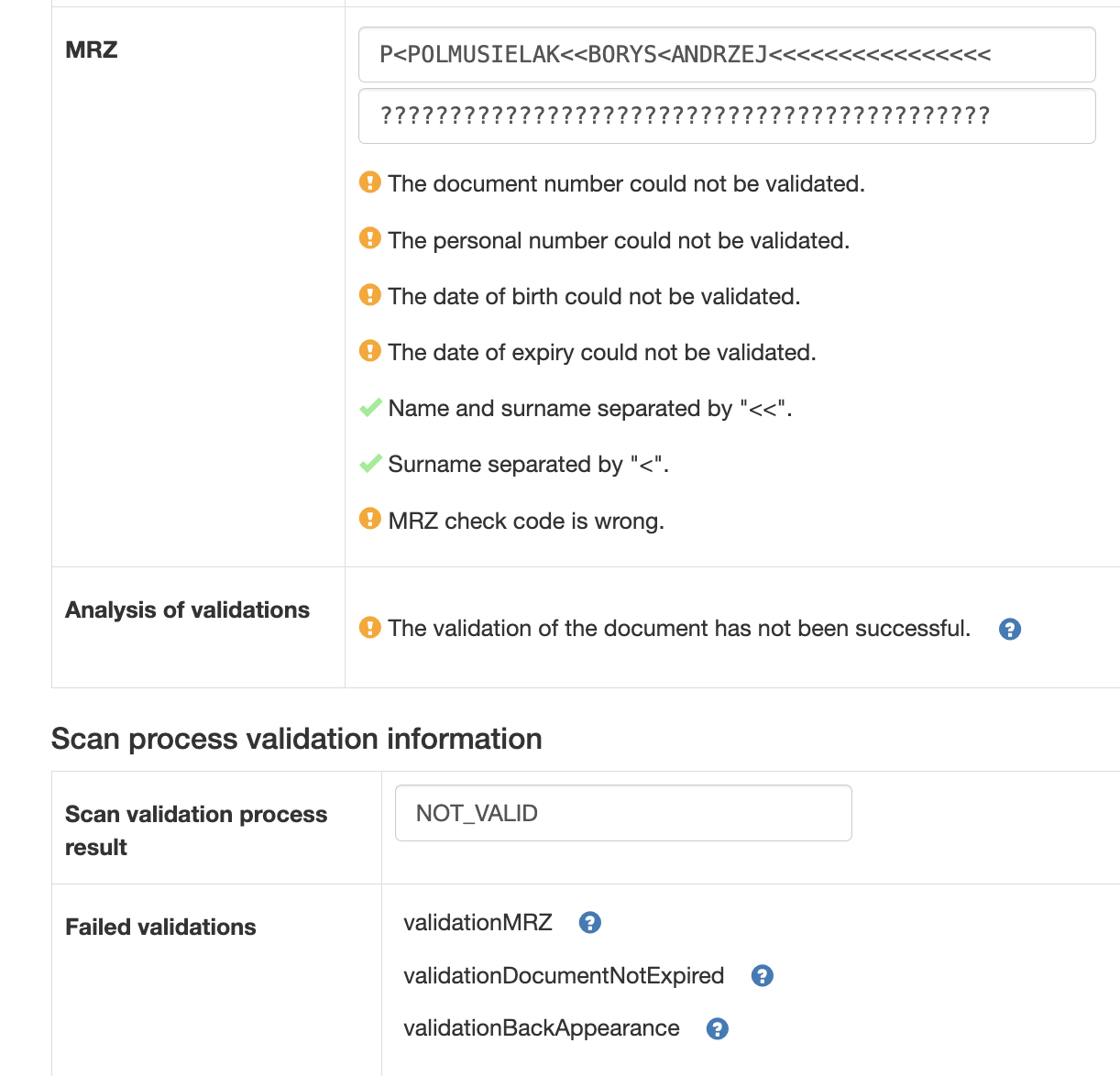

Realizamos una prueba con el pasaporte que ha desatado la polémica para evaluar si tiene capacidad de eludir los controles de nuestra solución de registro digital que incorpora un paso de captura y validación de documentos de identidad, MobbScan.

Se detectaron múltiples inconsistencias desde el primer momento:

- El formato del documento era desconocido.

- La fecha de nacimiento no se pudo reconocer ni validar.

- La nacionalidad aparecía como no válida.

- La MRZ presentó múltiples errores:

- El número de documento e identidad no pudieron validarse.

- La fecha de nacimiento y caducidad no pudieron validarse.

- El código de control generado por la MRZ era incorrecto.

Todo ello llevó a una conclusión: resultado del proceso NOT_VALID.

Este ejemplo demuestra cómo un documento que, a simple vista, podría parecer genuino, es desmontado automáticamente por nuestro sistema al identificar diferentes fallos.

La verificación documental solo es el primer paso del proceso

Detectar que un documento no es válido es solo uno de los pasos que puede incluir un proceso de verificación. Cuando se realiza la captura, nuestra tecnología analiza la imagen y lanza una batería de controles automáticos tanto de apariencia como de seguridad para comprobar si el documento cumple con los estándares internacionales y si ha sido manipulado o falsificado.

Gracias al uso de visión por computador, se inspecciona el aspecto físico del documento en busca de alteraciones. El sistema aplica una serie de controles específicos que, combinados, permiten emitir un resultado global sobre la validez del documento.

Entre los elementos que se comprueban están:

- El tipo de documento y su formato.

- La fuente tipográfica de la MRZ coincide con la oficial según el estándar ICAO 9303 (OCR-B).

- La región donde se encuentra la imagen facial no está alterada (por ejemplo con otra imagen superpuesta).

- Que los bordes y esquinas estén presentes, sin cortes o deformaciones.

- Se encuentran visibles todos los emblemas y distintivos oficiales.

Este análisis se hace en milisegundos. Y cuando algo no cuadra, como en el caso del pasaporte analizado, el sistema lo detecta y lo marca como inválido.

Comparación biométrica

Una vez validado el documento, se podría incorporar un segundo paso de biométrica facial. Este paso pretende verificar que la persona que presenta el documento es realmente quién dice ser.

Para ello, se compara la imagen facial impresa en el documento con una captura en tiempo real o selfie tomado por el usuario. Esta verificación se realiza mediante un motor biométrico basado en tecnologías de aprendizaje profundo, entrenado para tolerar diferencias como el paso del tiempo, cambios en el aspecto físico o la calidad variable de las imágenes.

Además, para proteger el proceso frente a otros intentos de suplantación, se incorporan mecanismos de detección de ataques de presentación y ataques de inyección. Estas medidas permiten identificar intentos de engaño usando fotografías, pantallas, máscaras o incluso deepfakes. La detección se realiza a través de técnicas pasivas sin requerir interacción adicional por parte del sujeto que realiza el proceso.

¿Más garantías? Las tenemos

En escenarios que requieren mayores niveles de seguridad, se puede añadir un tercer paso que consiste en una grabación completa del proceso y una revisión posterior por parte de un agente.

El reto no es el fraude, es identificarlo a tiempo

La amenaza del fraude documental, como sabemos, no es nueva. Lo que ha cambiado es la forma en la que se manifiesta: más rápida, más masiva, más automatizada.

La inteligencia artificial generativa ha acelerado los tiempos y ha reducido las barreras de entrada. Pero el verdadero riesgo no está solo en que esto ocurra, sino en no tener los mecanismos adecuados para detectarlo a tiempo.

En Mobbeel llevamos años trabajando con una idea clara: no se trata de adivinar si algo es falso o no. Se trata de analizar cada documento más allá de su apariencia y de anticiparse incluso a los fraudes que aún no se han producido.

Nuestros sistemas analizan múltiples señales en paralelo. Usamos redes neuronales entrenadas específicamente para distinguir entre documentos legítimos y aquellos generados sintéticamente, por muy bien construidos que estén. Las inconsistencias en los campos OCR, la lógica de la MRZ o incluso la coherencia entre la foto del documento y el selfie del usuario, todo se analiza en cuestión de segundos.

No se trata solo de saber si un documento es falso, sino de saberlo antes de que cause un daño real. Porque el fraude no necesita ser perfecto para funcionar. Solo necesita pasar una vez.

Y ahí es donde la tecnología marca la diferencia. La verificación ya no es una fase más del proceso, sino una barrera activa que solo puede funcionar si se alimenta de conocimiento, de experiencia y de una tecnología que esté lo suficientemente entrenada.

La clave no es detectar el fraude cuando ya ha ocurrido. La clave está en no darle la oportunidad de colarse.

Escríbenos si estás buscando una solución de verificación de identidad capaz de hacer frente al fraude de identidad con IA generativa.

Soy una mente inquieta con conocimientos en derecho, marketing y empresas. Una alquimista de la palabra, enamorada del neuromarketing y del copywriting, que ayuda a Mobbeel a seguir creciendo.

DOSIER PRODUCTO

Descubre nuestra solución de verificación de identidad

Verifica la identidad de tus clientes en segundos a través del escaneo y validación de documentos de identidad y matching biométrico facial con prueba de vida.